让AI生成内容“亮明身份”为何重要?

文化观察 | 2026-02-13 17:50:38原创

石念军 来源:大众新闻客户端

近来,AI生成内容成为热点,AI作品涌现的同时,诸多乱象也屡上热搜,引发批评。2月12日,“网信中国”发文,再度强调从严整治传播无标识的虚假不实信息问题,并公开部分典型案例。

同日,内容平台小红书发布公告,明确要求AI生成合成内容须主动标识,未标识内容将限制推荐。AI生成合成内容标识的合规问题成为当下亟待各内容平台和创作者们关注的问题。

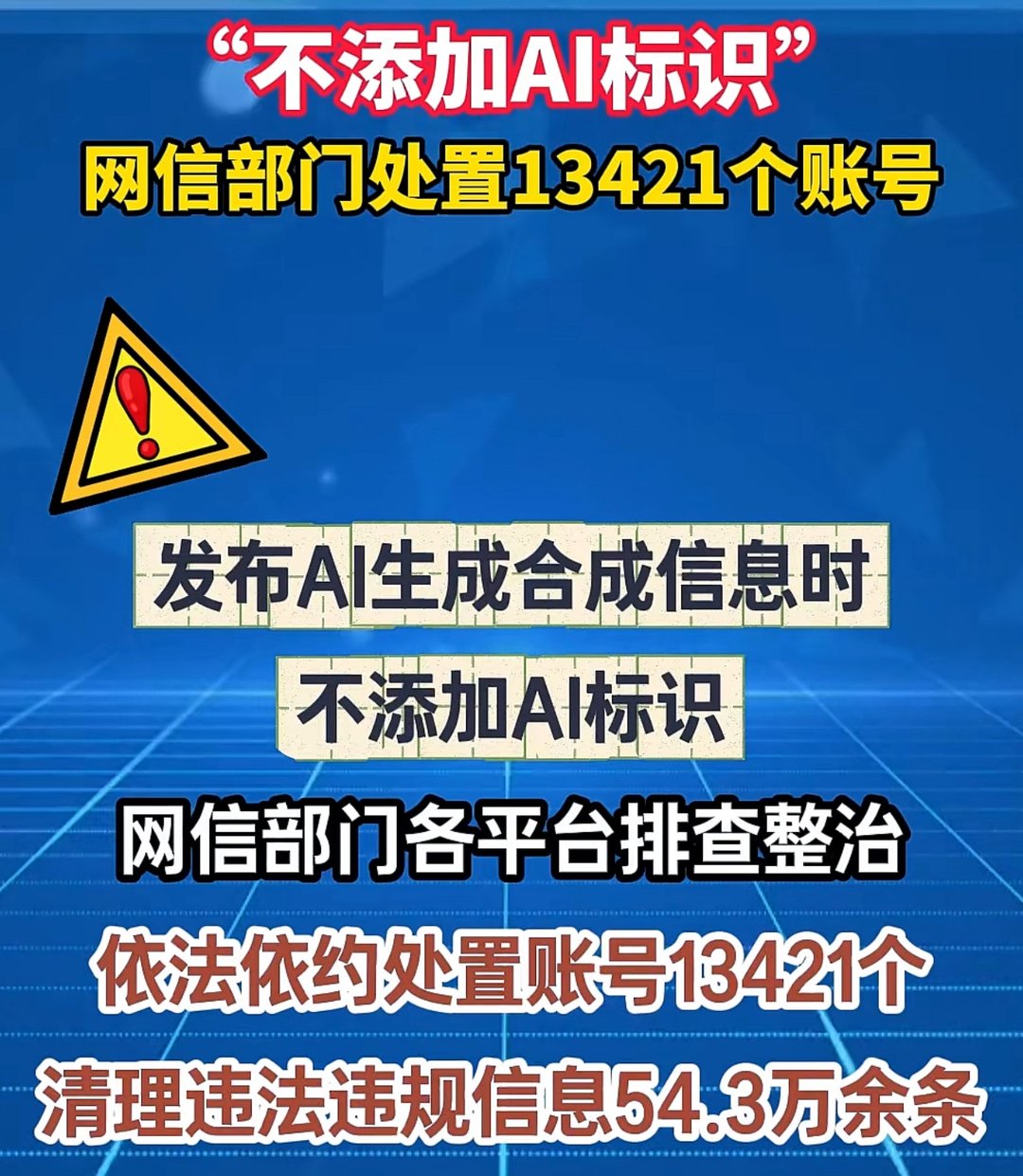

毋庸置疑,AI技术的迭代升级和普及应用不仅极大降低了内容门槛,提高了创作效率,而且大大拓展了我们表达的边界。许多创作者用AI产出精品内容,获得海量点赞,这充分说明技术本身并无原罪。然而,如“网信中国”发布的典型案例所揭示的,技术赋权若失去有效监管,就会形成负面效应。13421个账号被依法依约处置、54.3万余条违法违规信息被清理的数字更说明,无AI标识已从技术瑕疵演变为系统性网络现象,整治无AI标识问题刻不容缓。

无AI标识并非技术中立的表现,而是有意无意的身份遮蔽。普通用户基于对创作者身份的默认信任,往往将平台账号输出的内容默认为真实分享。此前,国家互联网信息办公室、工业和信息化部、公安部、国家广播电视总局联合制定《人工智能生成合成内容标识办法》,就是强调为AI作品赋予明确的“出身证明”,让技术产物回归工具本位。

除此之外,无AI标识而带来的延伸危害是通过AI制作的不实内容带来的误导效应。在“网信中国”的案例通报中,有人用AI编造“狗在高铁站救婴儿”的感人故事,只为博取廉价流量;有人用换脸技术假冒企业家、演员,堂而皇之售卖“拜年视频”牟利……这些行为不是内容创作,而是认知诈骗。而当这种行为规模化、产业化,网络生态便从信息场恶化为造假场。无标识内容与真实信息同台竞技,却无须承担人类创作者的时间成本、伦理约束、责任追溯,实为劣币驱逐良币。

甚至还有人将“魔改”的脏手伸向未成年人喜爱的动画角色,宣扬不良价值观。在这条灰色产业链的最下游,竟还有专门售卖去AI标识教程、软件的店铺,将误导公众做成了一门生意。这不是技术赋能,而是以技术做恶。

强化AI标识监管和治理是营造网络清朗空间的必然之举。它不假设所有AI内容都有害,也不预设所有创作者都会滥用技术,它只是要求当人与机器共同完成作品时,请让受众知道合作者的存在,倡导公平竞争、捍卫信任底线。

网信部门的整治传递出明确信号:无AI标识断非小事。对于承担着枢纽角色的平台而言,主动强化标识监管是“责任优先”的必然担当。当平台愿意主动压缩灰色地带的生存空间,就意味着开始将用户的长期信任置于短期的流量增长之上。这需要投入真实成本优化审核机制,也需要承受部分创作者的不满,但这是数字平台走向成熟的必修课。

创作者则需要完成从“被动合规”到“伦理自觉”的认知跃迁。正如纪实摄影师不会将合成照片标为抓拍,严肃作家不会让他人代笔却署自己名字,AI时代的创作者应当建立新的职业伦理。坦然承认技术辅助,恰恰是对自身创意的自信。当用户因明确标识而知晓内容生成背景时,那些真正融合人类巧思与AI效率的作品,反而更能经得起审视。

未来必然会有更智能的生成技术、更复杂的真假边界,它更加需要每一个创作者、运营者、平台自觉主动添加AI标识,才能最大限度地避免误导公众,共同营造风清气正的网络环境。也唯有如此,才是真正的技术赋能。

(大众新闻记者 石念军)

责任编辑:刘君

大众新闻原创内容,未经授权不得转载

转载事宜请联系大众新媒体大平台 联系电话:0531-85193469